生成AIのデメリットとは?無視できない6つの問題点を事例付きで徹底解説

「生成AIを活用するデメリットや問題点は何かあるだろうか?」

「便利そうではあるが、問題点があるのなら使わないほうがいいのかな……?」

「実際に起こった問題事例やその解決策を教えてほしい」

生成AIとは、文章や画像などを自動的に生み出せる人工知能の一種です。近年、あらゆる仕事に変革をもたらしており、業務効率化や労働力不足の解消に期待を寄せている方も多いでしょう。

しかし、生成AIの利用にはいくつかリスクが潜んでいるのも事実です。安全に運用していくためには、適切な対策を講じる必要があります。そこで本記事では、生成AIに潜む6つのデメリット・問題になった事例・その解決策を詳しく解説します。

生成AIにはさまざまな欠点がありますが、リスクを正しく理解し、適切に活用すれば大きな恩恵を受けられます。この機会に正しい利用方法を学んでいきましょう。

生成AIを利用する6つのデメリット

生成AIを利用する際は、以下6つのデメリット・問題点を知っておく必要があります。

- 著作権を中心とした権利侵害のリスクがある

- 出力情報の信頼性を確かめるのに手間がかかる

- 入力データが第三者に漏れてしまう可能性がある

- 生成結果が安定せず悪影響を与えることがある

- 適切な指示を与えないと低品質なコンテンツが生成される

- 学習データが偏っていると出力結果にも偏りが生まれる

順番に見ていきましょう。

1.著作権を中心とした権利侵害のリスクがある

まず挙げられるのは、著作権を中心とした権利侵害です。

生成AIはコンテンツを生成するために、Web上にあるさまざまなデータを学習しています。

その学習データの中には、著作物や商標権のあるものも含まれており、意図せずに権利を侵害してしまう可能性があるのです。

例えば、テキストコンテンツを生成する際には、小説や新聞の文章をそのまま使用してしまうかもしれません。

画像生成をする場合でも、著名な漫画家やイラストレーターの作品を学習していると、類似コンテンツになる場合があります。

現在の著作権法では、生成AIの学習データに著作物を含めることは原則認められています。著作権者に許可を取る必要もありません。

しかし、商用利用する場合は注意が必要です。著作権者から指摘を受けるケースがあります。また、倫理的な観点からも、企業や個人の信頼を大きく損なうおそれがあります。

参考:文化庁「AIと著作権」

2.出力情報の信頼性を確かめるのに手間がかかる

生成AIの利用において、出力情報の信頼性を確かめる手間は避けて通れません。なぜなら、生成AIの学習データには、Web上に存在する誤った情報やデータも含まれている場合があるからです。

例えば、個人のブログやSNS投稿では、憶測や推測による事実に基づかない情報や、個人の主観的な意見が発信されている場合があります。

また、無料のネット記事には、誤字脱字や数値の入力ミスなどの不正確な情報が含まれていることもあるでしょう。

生成AIがこのような誤情報を学習していると、架空の人物や企業や存在しない統計データを作り出してしまうこともあるのです。

もし、生成AIが作り出した誤情報をそのまま記事や報告書に載せてしまうと、企業や個人の信用を大きく損ねてしまうかもしれません。

したがって、生成AIを活用した情報発信では、出力データの真偽を入念に確かめることが重要です。

3.入力データが第三者に漏れてしまう可能性がある

生成AIを利用する際は、情報漏えいのリスクにも注意しなければなりません。なぜなら、生成AIは入力した文章を学習データとして活用する場合があるからです。

例えば、顧客の個人情報や社内の機密情報を入力してしまうと、それが第三者の生成結果に反映される可能性があります。

さらに、生成AIには不正利用を防ぐ目的で、入力情報を一定期間保存する仕組みがあります。もし、サイバー攻撃や不正アクセスが発生すると、情報が流出してしまうかもしれません。

このように、生成AIには情報漏えいのリスクがあります。入力データの管理には要注意です。

4.生成結果が安定せず悪影響を与えることがある

生成AIは、出力結果にランダム要素を含む仕様になっています。

これは、生成コンテンツに多様性をもたせるための仕組みです。よって、まったく同じプロンプト(指示文)を与えても毎回異なる結果が生成されます。

出力結果が毎回異なるのは、選択肢を増やすうえではメリットになりますが、裏を返すと「生成コンテンツの品質が安定しない」ともいえます。

この品質のばらつきは、企業や個人の信用問題に大きく影響を与えるものです。

例えば、広告素材や企業ブログに生成AIを活用する場合、これまでと異なる内容になれば、ブランドイメージを損ねてしまうかもしれません。

問い合わせ対応においては、人によって回答が異なると、顧客満足度が低下する可能性があります。

このように、生成結果の品質にばらつきがあるのは、あまり好ましい状況とはいえません。

よって、ビジネスシーンで生成AIを利用する場合は、出力結果にばらつきがあることを理解し、人間による監修を怠らないようにしましょう。

5.適切な指示を与えないと低品質なコンテンツが生成される

生成AIは、コンテンツを自動生成してくれる優れものですが、必ずしも高品質なものを作り出すわけではありません。

例えば「〇〇についての記事を書いてください」のような曖昧な指示では、理想とする生成結果にはならないでしょう。

これは人間の部下に指示する場合と同じです。生成AIも具体的な指示を与えないと、何をすればよいのか迷ってしまいます。そのため、理想の生成結果に近づけるためには、「誰に向けた記事なのか」「何を目的にしているのか」などの詳細条件まで指示する必要があるのです。

つまり、生成AIを活用する際は、適切な指示の出し方(プロンプトの書き方)を身につけることも重要です。

6.学習データが偏っていると出力結果にも偏りが生まれる

生成AIの出力結果は、学習データの影響を大きく受けています。つまり、学習データに偏りがあると、生成されるコンテンツにも偏りが生まれてしまうのです。

例えば、生成AIに「優秀な女性研究者の画像を生成してほしい」と指示しても、学習データに男性の研究者しか含まれていなければ、女性研究者の生成はできません。

また、自社製品に対して客観的な評価を求めても、学習データにポジティブな意見しか含まれていなければ、有益なアドバイスを得られないでしょう。

このように、生成AIは学習データに偏りがあると公平な判断ができなくなります。利用する際は、学習データの質と量にも注意が必要です。

生成AIで問題になった5つの事例

ここからは、実際に問題となった生成AIの活用事例を5つ紹介します。

- ChatGPTが告訴状を偽造

- 偽の被災画像がインターネット上で拡散

- 社内の機密コードが流出

- 人気作家が著作物侵害で提訴

- 採用システムで性差別が発覚

1.ChatGPTが告訴状を偽造

生成AIの誤情報生成(ハルシネーション)による問題の事例には、ChatGPTによる告訴状の偽造が挙げられます。

この事例では、OpenAIが開発する対話型AIのChatGPTが、米国のあるユーザーを「詐欺と横領の嫌疑にかけられた人物」と嘘の訴訟概要を作成したことで問題となりました。

実際の訴訟は、ある財団が司法長官に対して起こしたものです。しかし、嘘をでっちあげられたユーザーはその財団で働いたことすらないと主張しています。

ChatGPTを開発するOpenAIは、リリース当初から誤情報や偏見情報を生成する場合があると警告しており、学術誌や国際会議では使用を禁止しているところもあります。

ChatGPTに限った話ではなく、生成AIを利用して情報発信をする際は、人の目で真偽を確かめることが重要です。

参考:ChatGPTが告訴状を「偽造」 米男性、名誉毀損でオープンAI提訴|Forbes JAPAN

2.偽の被災画像がインターネット上で拡散

生成AIを悪用して問題となった事例もあります。

2022年9月26日、Twitter(現:X)に突然「水害」の画像が投稿されました。

この衝撃的な画像は瞬く間に拡散されましたが、実際は生成AIによって作られた巧妙な偽画像(ディープフェイク)だったようです。

昨今、生成AIは急激に進化しており、人の手によって作られた画像や動画と見分けがつかなくなっています。

この事例では目的や計画性はなかったようですが、家族や知人になりすました詐欺や、著名人を利用した情報操作などに利用される可能性もあります。

よって、これからの時代は自らが生成AIで出力した情報だけでなく、Web上にあるコンテンツに対しても批判的な目でチェックすることが大切です。

参考:「マジで悲惨すぎる…」被災の画像、実はディープフェイクだった 高まる生成AIの悪用懸念にどう向き合う?|Yahoo!ニュース

3.社内の機密コードが流出

生成AIによる情報漏えい事例としては、サムスンの機密コード流出事件が挙げられます。

この事例では、同社に勤めるエンジニアが、社内機密のソースコードを誤ってChatGPTにアップロードしたことで問題となりました。

情報流出の被害が、どれほど重大だったのかは明らかにされていません。しかし、サムスンはこの事件を受けて、社内での生成AIツールを使用禁止としました。

ChatGPTを含む多くの生成AIツールには「チャット履歴の削除機能」を設けています。しかし、不正利用の防止目的から、1週間程度は保存されるのが一般的です。

つまり、生成AIの情報漏えいリスクは避けられません。導入する際は、社内全体で情報管理を徹底する必要があります。

参考:サムスン、ChatGPTの社内使用禁止 機密コードの流出受け|Forbes JAPAN

4.人気作家が著作物侵害で提訴

生成AIによる著作権侵害事例としては、米国の人気作家による提訴が挙げられます。

この事例では「ゲーム・オブ・スローンズ」の作者であるジョージ・R・R・マーティン氏を含む10人以上の作家が、自分たちの著作物が学習データに使用されたとして、ChatGPTを提訴しました。

現行の法律では、AIが著作物を学習データに使用するのは問題ないとされています。

しかし、彼らは生成AIを「小説家の生計を脅かすもの」とし、著作者は補償を受けるべきだと主張しています。

このように、法律上は問題がなくても、著作者の許可なく類似コンテンツを生成すると訴訟を起こされる場合があります。

今回は生成AIの開発企業に対する訴訟事例ですが、倫理的な観点から、ツールの使用者もイメージダウンにつながる可能性があります。権利侵害には注意しましょう。

参考:『ゲーム・オブ・スローンズ』原作者らがOpenAIを著作権侵害で提訴|Forbes JAPAN

5.採用システムで性差別が発覚

出力結果の偏りが引き起こした問題事例としては、アマゾンの採用活動が挙げられます。

同社は、過去10年分の履歴書を生成AIに学習させ、応募者を自動でランク付けする仕組みを導入しました。

しかし、実際に運用すると「女性差別」という重大な欠陥が見つかりました。これは過去に提出された履歴書のほとんどが「男性」によるものだったのが原因です。

生成AIは「男性を優先的に採用するのが望ましい」と判断してしまい、履歴書に「女性」関連の単語が含まれているだけで、応募者の評価を下げる傾向にあったのです。

アマゾンでは、この性差別に対するプログラムを修正しましたが、別の差別をもたらす可能性を否定できないとしてシステムの運用を取りやめました。

このように、生成AIで業務効率化をしても、学習データに偏りがあると望む結果を得られません。利用する際は、偏りやバイアスについても慎重に精査する必要があります。

参考:焦点:アマゾンがAI採用打ち切り、「女性差別」の欠陥露呈で|Reuters

生成AIのデメリットに対する解決策6選

生成AIにはさまざまなデメリットが存在するため、活用の際は正しい対策を講じることが大切です。

生成AIのデメリットに対する解決策としては、以下の6つが挙げられます。

- 人間によるファクトチェックを徹底する

- 説明可能なAI(XAI)を導入する

- 入力データを学習させない・履歴を残さない設定にする

- プロンプト(指示文)を詳細に指定する

- 従業員向けにガイドラインを策定する

- 社内でAIリテラシー教育をする

順番に見ていきましょう。

1.人間によるファクトチェックを徹底する

生成AIは、Web上にあるさまざまな情報を学習データに活用します。その仕組みから、誤情報の生成(ハルシネーション)を防ぐことは難しいでしょう。

したがって、出力結果を利用する際は、信頼できる情報かファクトチェックを徹底する習慣が大切です。

例えば、以下を習慣化させるとよいでしょう。

- 情報ソースの信頼性を確認する

- 信頼できるサイトと情報を照らし合わせる

- 複数人によるダブルチェックをする

また、ファクトチェックをする際は、生成AIによって作られた誤情報(ディープフェイク)にも要注意です。

政治家や著名人が発言している動画であっても、それは一般人によって生成された悪質な詐欺動画かもしれません。少しでも違和感がある場合は、疑うようにしましょう。

2.説明可能なAI(XAI)を導入する

ファクトチェックの手間を軽減するには、説明可能なAI(XAI)を導入するのもひとつの手段です。

説明可能なAI(XAI)とは、その名の通り、生成結果の背後にあるロジック(論理的な根拠)を説明できる人工知能を指します。

従来のAIでは、どのようにして結論に至ったのか見えにくい状態でした。結果、誤情報に気がつかない場面もたくさんあったわけです。

しかし、説明可能なAI(XAI)を用いることで、どのような情報に基づいて判断されたのかが明らかになります。理由が明確になることで、回答結果を受け入れやすくなるでしょう。

生成AIを導入する際は、安心して利用できるツールを選ぶことも大切です。

3.入力データを学習させない・履歴を残さない設定にする

生成AIの情報漏えい対策としては「入力データを学習させない」「履歴を残さない」といった設定をするとよいでしょう。

すべてのツールに備わっているわけではありません。しかし、著名なツールであれば設定可能な場合が多いです。

もちろん、漏れて困る情報は入力しないのが一番の対策となります。

しかし、事例にもあったように、従業員が誤って入力してしまう可能性があります。よって、最低限の対策として設定しておくのがおすすめです。

4.プロンプト(指示文)を詳細に指定する

生成AIは、人の指示なしには動きません。また生成コンテンツの質は、プロンプト(指示文)の質によって左右されます。

よって、低品質なコンテンツの生成を避けるためには、プロンプト(指示文)の質を高めることが重要です。

例えば、お礼のビジネスメールを作成をする場合は、「お礼のビジネスメールを作成して」と指示するのではなく、以下のように詳細な条件を与えると理想に近づきます。

【お礼のビジネスメールを生成するプロンプト例】

ーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーー

あなたは広告代理店の営業担当者です。

以下の情報をもとに、お礼の気持ちを伝えるビジネスメールを作成してください。

#条件

・文字数:400文字以内

・トーン:堅くなりすぎない

#伝えたい内容

・打ち合わせに参加してくれたことへの感謝

・次回打ち合わせ日程調整の依頼

・返信期限:来週の月曜日まで

#出力形式

・件名:

・本文:

ーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーー

同じように、犬の画像を生成する際も「犬の画像」と曖昧に伝えるのではなく、「夕日の海辺を散歩するゴールデンレトリーバーの画像」のように入力します。するとイメージに近い画像をいくつか生成してくれるでしょう。

このように、生成AIを使いこなすには「プロンプト(指示文)」の工夫が求められます。人間の部下に伝えるイメージで、わかりやすい情報を提供するのが大切です。

5.従業員向けにガイドラインを策定する

生成AIを社内で利用するのなら、従業員向けにガイドラインを策定するのがおすすめです。

出力情報のファクトチェックをする方法や、入力してはいけないデータなどのルールを定めておくことでリスクを最小限に抑えられます。

生成AIのガイドラインを作る際は、日本ディープラーニング協会の資料を参考にするとよいでしょう。

参考:生成AIの利用ガイドライン|日本ディープラーニング協会

6.社内でAIリテラシー教育を実施する

企業が生成AIのリスク対策をする際は、ガイドラインの策定に加えて、AIリテラシー教育を実施することも重要です。

生成AIの基本的な仕組み・活用方法・リスクなどを社内全体で学ぶことで、誰がAIツールを使用しても適切に運用できます。

近年は、政府がAI人材の教育を後押ししていることもあり、AIリテラシーに関わる教育コンテンツが豊富に展開されています。積極的に活用して、組織全体の理解度を高めましょう。

生成AIは対策さえすれば大きなメリットを得られる

生成AIには、デメリットが潜んでいる一方で、しっかり対策を講じれば大きな恩恵を得られるのも事実です。

今後のビジネスシーンでは、生成AIを適切に活用しているかどうかで大きな差が生じるといっても過言ではありません。

以降では、生成AIを活用する4つのメリットを改めて確認していきましょう。

- 人間にしかできない業務に集中できる

- 膨大なデータに基づいた意思決定ができる

- 新しいアイデアのインスピレーションを得られる

- 社内の人手不足や属人化を解消できる

1.人間にしかできない業務に集中できる

生成AIを有効活用することで、私たちは人間にしかできない業務に集中できます。なぜなら、単純作業やパターン化された業務の大部分を自動化できるからです。

例えば、営業職では顧客データの入力やレポート作成は自動化しやすい業務といえます。しかし、手作業では多くの時間と労力がかかってしまうでしょう。

こうした業務を生成AIに任せれば、営業担当者は顧客との商談や戦略立案といった「本来注力すべき業務」に時間を使えます。結果、生産性が向上し、労働時間の短縮も実現可能となるわけです。

生成AIは、単純作業を得意とする一方で、コミュニケーションや創造性などの人間らしい業務にはまだまだ対応できません。

よって、生成AIと人間は協力関係を築くことが、今後のビジネスシーンでは大切な姿勢となります。

2.膨大なデータに基づいた意思決定ができる

生成AIは、膨大なデータの処理・分析に優れており、ビジネスにおける意思決定の迅速化に役立ちます。

例えば、生成AIに顧客の取引履歴や商談状況を分析してもらうことで、各顧客がどんなことに興味関心を持っているのか把握しやすくなります。

結果、アプローチすべき顧客の優先順位が決めやすくなるはずです。見込み度の高い顧客を見極めやすくなることで、無駄なアプローチにかかる時間と労力も削減できます。

今はインターネットやツールからさまざま情報を取得できますが、人間だけで多くの情報を処理するのは限界があります。ゆえに、ベテラン社員の経験や勘への依存度がいまだに高い企業も多いのではないでしょうか。

その点、生成AIのデータ分析を活用すれば、経験の浅い社員でも適切な意思決定がしやすくなります。貴重なデータを最大限に有効活用できるのは、生成AIを導入する大きなメリットといえるでしょう。

3.新しいアイデアのインスピレーションを得られる

生成AIを活用することは、新しいアイデアのインスピレーション(閃き)を得るうえでも有効になります。

人間は新しいアイデアを考える際、どうしても既存の知識や過去の経験からヒントを探そうとしてしまいます。業界の常識に囚われて思考を狭めてしまうこともあるでしょう。

しかし、生成AIに質問をすれば、膨大なデータ分析によって導かれた選択肢をいくつか提案してくれます。中には「この視点はなかった」と唸るような提案が含まれていることもあり、視野を広げた発想につながる可能性があります。

子供や他業界の知人と話をしたことで、画期的なアイデアが浮かんだ経験はないでしょうか。これは自分自身の経験や常識から外れることで、新たな視点を得たからです。

同じような体験が、生成AIを活用することでできるかもしれません。アイデアを考える際の壁打ち相手として使ってみるとよいでしょう。

4.社内の人手不足や属人化を解消できる

生成AIをさまざまな業務に活用すれば、人手不足や属人化の解消につながります。

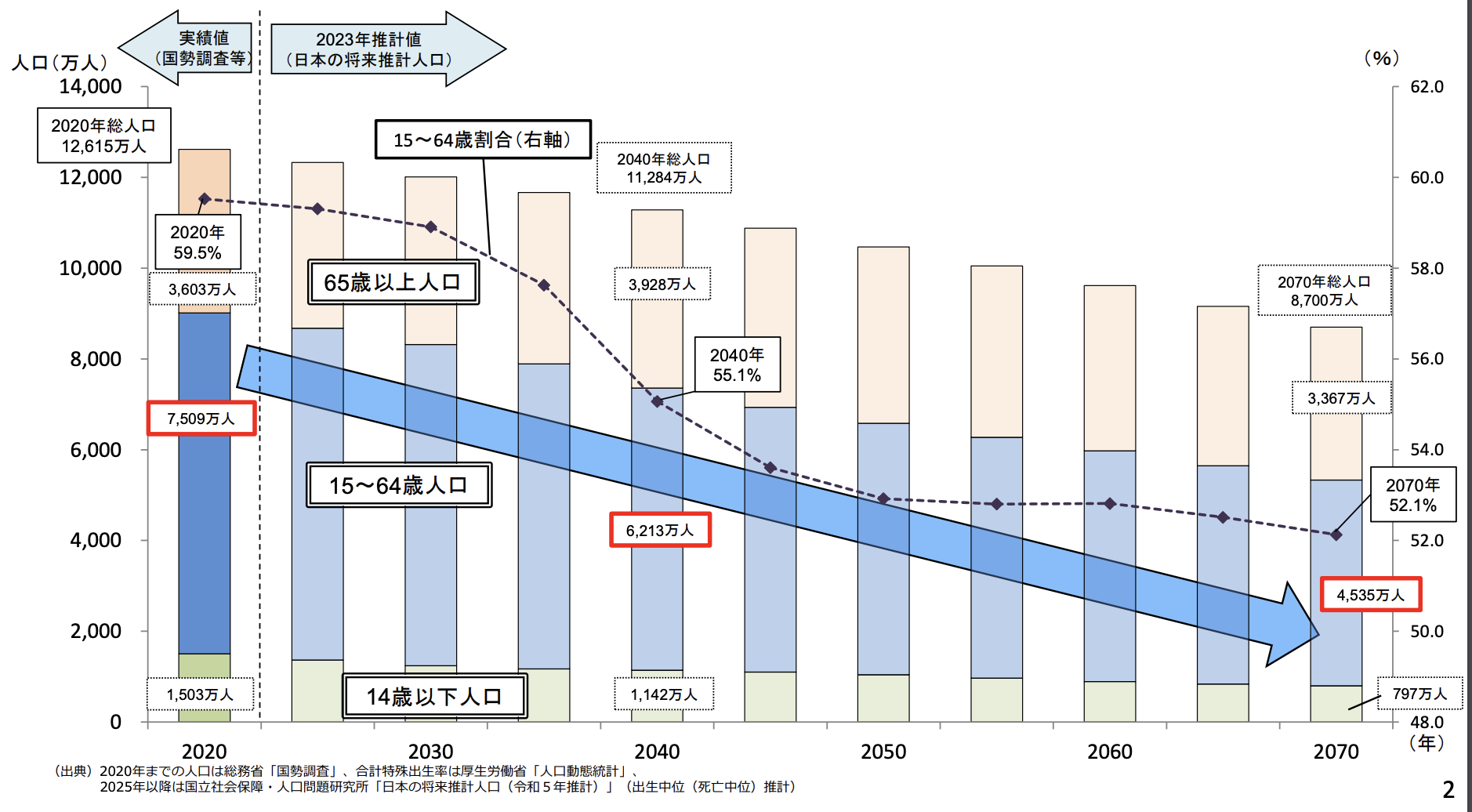

日本では少子高齢化が進んでおり、労働人口不足が深刻化しています。

厚生労働省の発表によると、2020年には7,509万人いた労働人口(15〜64歳)が、2070年には4,535万人に減少すると予測されています。

出典:人口減少社会への対応と人手不足の下での企業の人材確保に向けて|厚生労働省

こうした労働人口の減少が続く中では、人材確保や育成に力を入れてもなかなか人手不足の解消にはつながりません。

その点、生成AIを導入すれば、定型的な業務のほとんどを自動化可能です。従業員は人間にしかできない業務に集中できるため、少人数でも生産性アップが期待できるでしょう。

さらに、生成AIに熟練者社員のスキルを学習させることで、限られた社員にパフォーマンスが集中する業務の属人化も解消できます。「〇〇さんがいないと仕事にならない」という事態がなくなることで、組織全体の生産性向上が期待できます。

労働人口が減り続ける限り、採用活動による人手不足や属人化の解消は極めて難しいのが実情です。生成AIを効果的に活用して、業務効率化を図っていきましょう。

まとめ:生成AIのデメリットを理解して業務効率化を実現させよう

生成AIは、機械学習やディープラーニングの性質上、どうしても誤情報の生成や権利侵害などのリスクが生じてしまいます。

また、情報漏えいを防ぐためや、出力結果の偏りを生まないための入力データ管理も徹底する必要があります。

しかし、どの問題点についても利用者が適切な対策を講じることで解消可能です。技術発展や法整備による改善も期待できます。

生成AIは、今後のビジネス発展に欠かせないものであるため、メリット・デメリットを正しく把握して積極的に活用していきましょう。

この記事の監修

Sooon株式会社 「AI×営業」などの最先端ノウハウを発信。弊社スクールにて、ChatGPT、Gemini、FeloなどのAIツールを活用した営業効率化手法を開発し、非エンジニアでも実装可能なメソッドを指導。「GMOコラボ 生成AI大感謝祭」に登壇者として、「AIグランプリ2025 春」に審査員として参加。